Se encontraron 13 coincidencias

- 04 Dic 2018, 09:57

- Foros: App Móviles

- Tema: 5 de las mejores aplicaciones de IA de 2018

- Respuestas: 0

- Vistas: 17016

5 de las mejores aplicaciones de IA de 2018

Gartner predice que para 2022, el 80 por ciento de los teléfonos inteligentes estará equipado con capacidades IA en el dispositivo, un aumento del 10 por ciento en este momento.

En el vídeo mostrado a continuación podrá ver algunas de las aplicaciones de IA más increíbles de 2018.

En el vídeo mostrado a continuación podrá ver algunas de las aplicaciones de IA más increíbles de 2018.

- 02 Dic 2018, 20:43

- Foros: BI & Data Sciences

- Tema: Data Science vs. Big Data vs. Data Analytics [Parte 4]

- Respuestas: 0

- Vistas: 4250

Data Science vs. Big Data vs. Data Analytics [Parte 4]

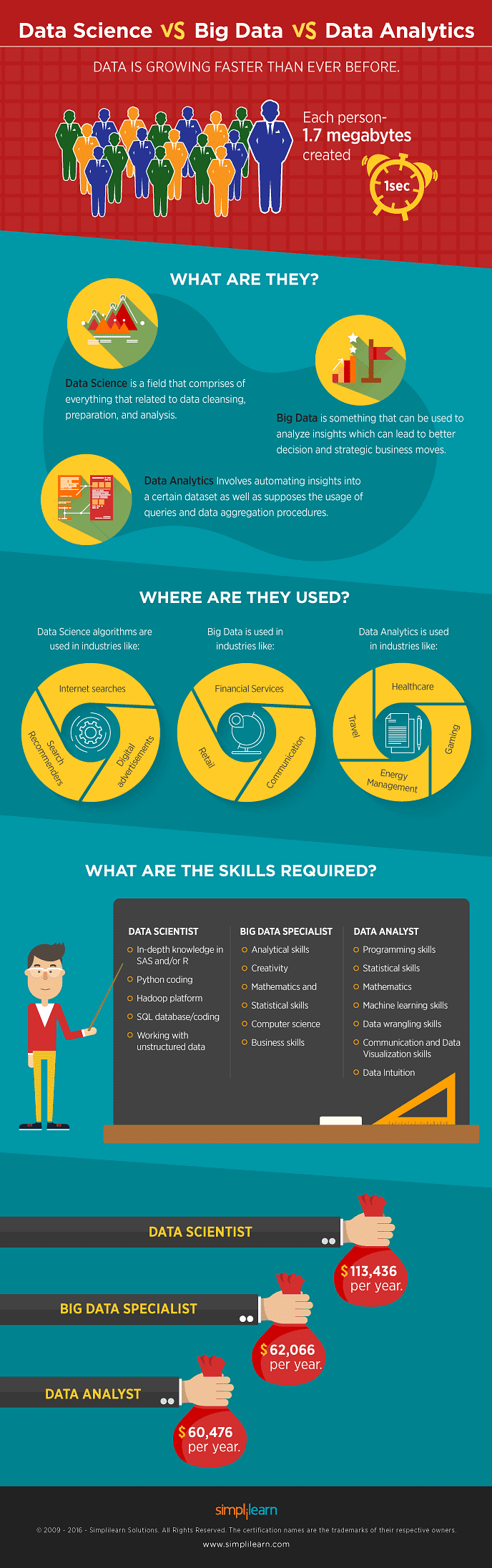

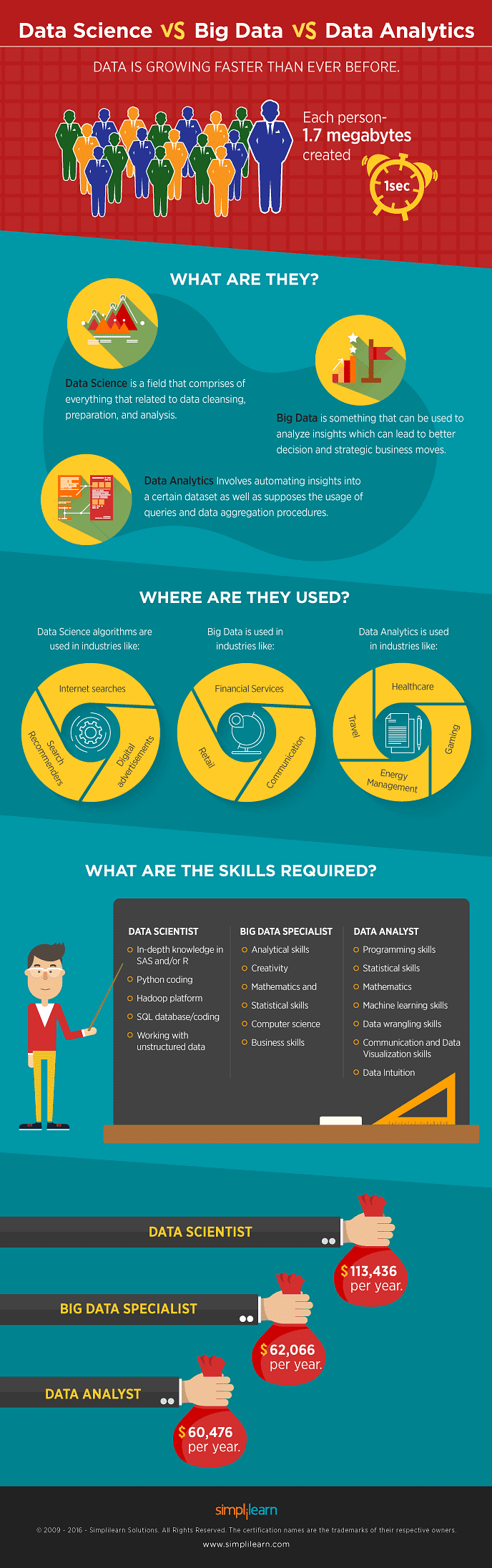

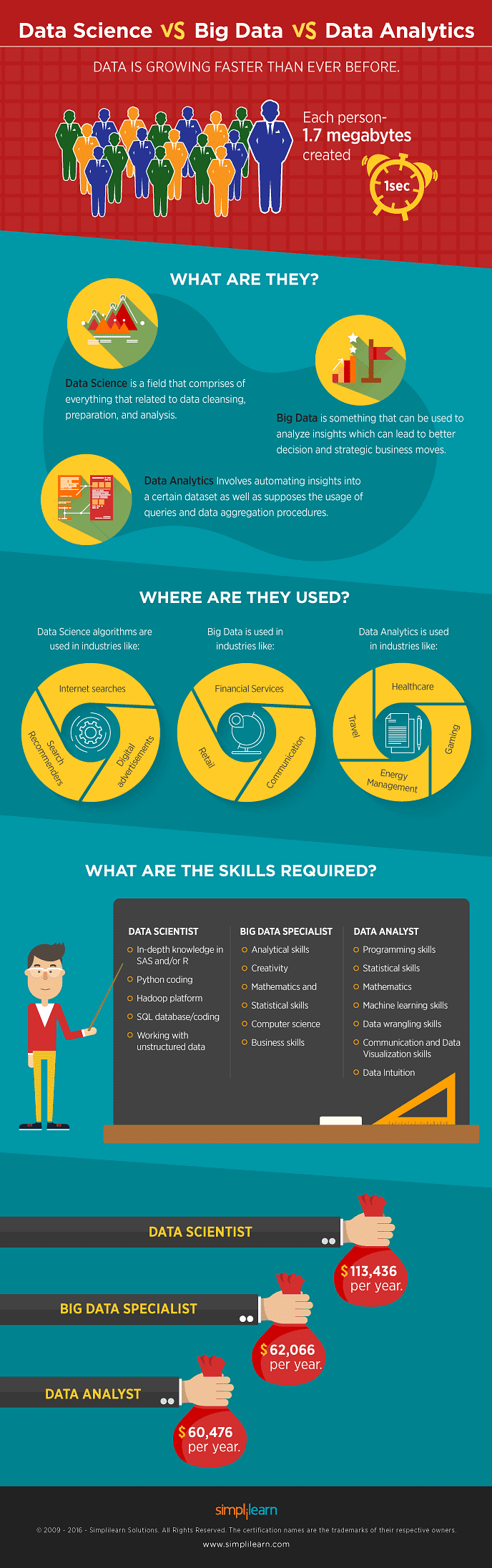

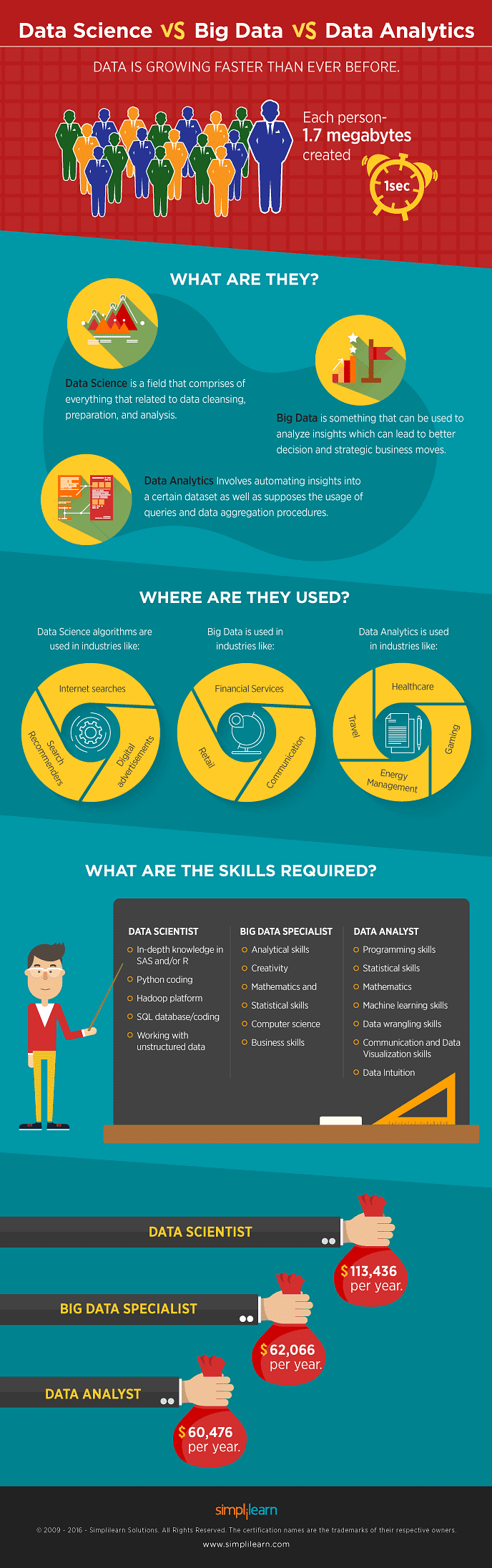

¡Ahora hablemos de salarios!

Aunque en el mismo dominio, cada uno de estos profesionales, data scientists, especialistas en Big Data y data analysts, ganan salarios variados.

El promedio que un data scientists gana hoy, según Indeed.com es de $ 123,000 al año. Según Glassdoor , el salario promedio de un Data Scientist es de $ 113,436 por año.

https://www.glassdoor.com/Salaries/us-d ... KO3,17.htm

El salario promedio de un especialista en Big Data según Glassdoor es de $ 62,066 por año.

https://www.glassdoor.com/Salary/iQuadr ... KO8,27.htm

El salario promedio de un data analysts según Glassdoor es de $ 60,476 por año.

https://www.glassdoor.com/Salaries/us-d ... KO3,15.htm

Ahora que conoce las diferencias, ¿cuál cree que es la más adecuada para usted: la ciencia de datos? Big Data? ¿O análisis de datos?

Fuente: SimpliLearn

Aunque en el mismo dominio, cada uno de estos profesionales, data scientists, especialistas en Big Data y data analysts, ganan salarios variados.

El promedio que un data scientists gana hoy, según Indeed.com es de $ 123,000 al año. Según Glassdoor , el salario promedio de un Data Scientist es de $ 113,436 por año.

https://www.glassdoor.com/Salaries/us-d ... KO3,17.htm

El salario promedio de un especialista en Big Data según Glassdoor es de $ 62,066 por año.

https://www.glassdoor.com/Salary/iQuadr ... KO8,27.htm

El salario promedio de un data analysts según Glassdoor es de $ 60,476 por año.

https://www.glassdoor.com/Salaries/us-d ... KO3,15.htm

Ahora que conoce las diferencias, ¿cuál cree que es la más adecuada para usted: la ciencia de datos? Big Data? ¿O análisis de datos?

Fuente: SimpliLearn

- 02 Dic 2018, 20:37

- Foros: BI & Data Sciences

- Tema: Data Science vs. Big Data vs. Data Analytics [Parte 3]

- Respuestas: 0

- Vistas: 2998

Data Science vs. Big Data vs. Data Analytics [Parte 3]

Las habilidades que necesitas:

Para convertirse en un Data Scientist:

Educación: el 88% tiene una maestría y el 46% tiene un doctorado

Educación: el 88% tiene una maestría y el 46% tiene un doctorado

Conocimiento profundo de SAS y / o R: Para Data Science, generalmente se prefiere R.

Conocimiento profundo de SAS y / o R: Para Data Science, generalmente se prefiere R.

Codificación de Python: Python es el lenguaje de codificación más común que se utiliza en la ciencia de datos junto con Java, Perl, C / C ++.

Codificación de Python: Python es el lenguaje de codificación más común que se utiliza en la ciencia de datos junto con Java, Perl, C / C ++.

Plataforma Hadoop: aunque no siempre es un requisito, conocer la plataforma Hadoop sigue siendo el preferido para el campo. Tener un poco de experiencia en Hive o Pig es también un gran punto de venta.

Plataforma Hadoop: aunque no siempre es un requisito, conocer la plataforma Hadoop sigue siendo el preferido para el campo. Tener un poco de experiencia en Hive o Pig es también un gran punto de venta.

Base de datos / codificación SQL: aunque NoSQL y Hadoop se han convertido en una parte importante del fondo de Data Science, todavía es preferible si puede escribir y ejecutar consultas complejas en SQL.

Base de datos / codificación SQL: aunque NoSQL y Hadoop se han convertido en una parte importante del fondo de Data Science, todavía es preferible si puede escribir y ejecutar consultas complejas en SQL.

Trabajar con datos no estructurados: es muy importante que un científico de datos pueda trabajar con datos no estructurados, ya sea en las redes sociales, videos o audio.

Trabajar con datos no estructurados: es muy importante que un científico de datos pueda trabajar con datos no estructurados, ya sea en las redes sociales, videos o audio.

Para convertirse en un profesional de Big Data:

Habilidades analíticas: la capacidad de poder dar sentido a las pilas de datos que obtiene. Con habilidades analíticas, podrá determinar qué datos son relevantes para su solución, más como la resolución de problemas.

Habilidades analíticas: la capacidad de poder dar sentido a las pilas de datos que obtiene. Con habilidades analíticas, podrá determinar qué datos son relevantes para su solución, más como la resolución de problemas.

Creatividad: debe tener la capacidad de crear nuevos métodos para recopilar, interpretar y analizar una estrategia de datos. Esta es una habilidad extremadamente adecuada para poseer.

Creatividad: debe tener la capacidad de crear nuevos métodos para recopilar, interpretar y analizar una estrategia de datos. Esta es una habilidad extremadamente adecuada para poseer.

Matemáticas y habilidades estadísticas: buenas, anticuadas, "crujido de números". Esto es extremadamente necesario, ya sea en ciencia de datos, análisis de datos o big data.

Matemáticas y habilidades estadísticas: buenas, anticuadas, "crujido de números". Esto es extremadamente necesario, ya sea en ciencia de datos, análisis de datos o big data.

Ciencias de la computación: las computadoras son la pieza clave detrás de cada estrategia de datos. Los programadores tendrán una necesidad constante de idear algoritmos para procesar datos en perspectivas.

Ciencias de la computación: las computadoras son la pieza clave detrás de cada estrategia de datos. Los programadores tendrán una necesidad constante de idear algoritmos para procesar datos en perspectivas.

Habilidades empresariales: los profesionales de Big Data deberán comprender los objetivos comerciales establecidos, así como los procesos subyacentes que impulsan el crecimiento de la empresa y sus beneficios.

Habilidades empresariales: los profesionales de Big Data deberán comprender los objetivos comerciales establecidos, así como los procesos subyacentes que impulsan el crecimiento de la empresa y sus beneficios.

Para convertirse en un Data Analyst:

Habilidades de programación: saber que los lenguajes de programación son R y Python son extremadamente importantes para cualquier analista de datos.

Habilidades de programación: saber que los lenguajes de programación son R y Python son extremadamente importantes para cualquier analista de datos.

Habilidades estadísticas y matemáticas: las estadísticas descriptivas e inferenciales y los diseños experimentales son una necesidad para los científicos de datos.

Habilidades estadísticas y matemáticas: las estadísticas descriptivas e inferenciales y los diseños experimentales son una necesidad para los científicos de datos.

Habilidades de aprendizaje automático.

Habilidades de aprendizaje automático.

Habilidades de manejo de datos: la capacidad de mapear datos en bruto y convertirlos en otro formato que permita un consumo más conveniente de los datos.

Habilidades de manejo de datos: la capacidad de mapear datos en bruto y convertirlos en otro formato que permita un consumo más conveniente de los datos.

Habilidades de comunicación y visualización de datos.

Habilidades de comunicación y visualización de datos.

Intuición de datos: es extremadamente importante para un profesional poder pensar como un analista de datos.

Intuición de datos: es extremadamente importante para un profesional poder pensar como un analista de datos.

Fuente: SimpliLearn

Para convertirse en un Data Scientist:

Para convertirse en un profesional de Big Data:

Para convertirse en un Data Analyst:

Fuente: SimpliLearn

- 02 Dic 2018, 20:27

- Foros: BI & Data Sciences

- Tema: Data Science vs. Big Data vs. Data Analytics [Parte 2]

- Respuestas: 0

- Vistas: 3091

Data Science vs. Big Data vs. Data Analytics [Parte 2]

Las aplicaciones de cada campo:

Aplicaciones de Data Science:

Búsqueda en Internet: los motores de búsqueda utilizan algoritmos de ciencia de datos para ofrecer mejores resultados para consultas de búsqueda en una fracción de segundos.

Búsqueda en Internet: los motores de búsqueda utilizan algoritmos de ciencia de datos para ofrecer mejores resultados para consultas de búsqueda en una fracción de segundos.

Anuncios digitales: todo el espectro del marketing digital utiliza los algoritmos de la ciencia de la información, desde pancartas hasta carteles digitales. Esta es la razón principal por la que los anuncios digitales obtienen un CTR más alto que los anuncios tradicionales.

Anuncios digitales: todo el espectro del marketing digital utiliza los algoritmos de la ciencia de la información, desde pancartas hasta carteles digitales. Esta es la razón principal por la que los anuncios digitales obtienen un CTR más alto que los anuncios tradicionales.

Sistemas de recomendación: los sistemas de recomendación no solo facilitan la búsqueda de productos relevantes de los miles de millones de productos disponibles, sino que también añaden mucho a la experiencia del usuario. Muchas empresas utilizan este sistema para promocionar sus productos y sugerencias de acuerdo con las demandas del usuario y la relevancia de la información. Las recomendaciones se basan en los resultados de búsqueda anteriores del usuario.

Sistemas de recomendación: los sistemas de recomendación no solo facilitan la búsqueda de productos relevantes de los miles de millones de productos disponibles, sino que también añaden mucho a la experiencia del usuario. Muchas empresas utilizan este sistema para promocionar sus productos y sugerencias de acuerdo con las demandas del usuario y la relevancia de la información. Las recomendaciones se basan en los resultados de búsqueda anteriores del usuario.

Aplicaciones de Big Data:

Big Data para servicios financieros: las compañías de tarjetas de crédito, los bancos minoristas, los asesores privados de gestión de patrimonio, las compañías de seguros, los fondos de riesgo y los bancos de inversión institucional utilizan Big Data para sus servicios financieros. El problema común entre todos ellos es la gran cantidad de datos multi-estructurados que viven en múltiples sistemas dispares que pueden ser resueltos por big data. Por lo tanto, el big data se usa de varias maneras como:

Big Data para servicios financieros: las compañías de tarjetas de crédito, los bancos minoristas, los asesores privados de gestión de patrimonio, las compañías de seguros, los fondos de riesgo y los bancos de inversión institucional utilizan Big Data para sus servicios financieros. El problema común entre todos ellos es la gran cantidad de datos multi-estructurados que viven en múltiples sistemas dispares que pueden ser resueltos por big data. Por lo tanto, el big data se usa de varias maneras como:

- Analítica de clientes

- Analítica de cumplimiento

- Analítica de fraudes

- Analítica operativa

Big Data en comunicaciones: la obtención de nuevos suscriptores, la retención de clientes y la expansión dentro de las bases de suscriptores actuales son las principales prioridades para los proveedores de servicios de telecomunicaciones. Las soluciones a estos desafíos se encuentran en la capacidad de combinar y analizar las masas de datos generados por el cliente y datos generados por máquinas que se crean todos los días.

Big Data en comunicaciones: la obtención de nuevos suscriptores, la retención de clientes y la expansión dentro de las bases de suscriptores actuales son las principales prioridades para los proveedores de servicios de telecomunicaciones. Las soluciones a estos desafíos se encuentran en la capacidad de combinar y analizar las masas de datos generados por el cliente y datos generados por máquinas que se crean todos los días.

Big Data para el sector minorista: Brick and Mortar o un distribuidor en línea, la respuesta para mantener el juego y ser competitivo es entender mejor al cliente para que les sirva. Esto requiere la capacidad de analizar todas las fuentes de datos dispares con las que las compañías lidian todos los días, incluidos los weblogs, los datos de transacciones de los clientes, las redes sociales, los datos de tarjetas de crédito con la marca de la tienda y los datos del programa de fidelidad.

Big Data para el sector minorista: Brick and Mortar o un distribuidor en línea, la respuesta para mantener el juego y ser competitivo es entender mejor al cliente para que les sirva. Esto requiere la capacidad de analizar todas las fuentes de datos dispares con las que las compañías lidian todos los días, incluidos los weblogs, los datos de transacciones de los clientes, las redes sociales, los datos de tarjetas de crédito con la marca de la tienda y los datos del programa de fidelidad.

Aplicaciones de Data Analytics:

Atención médica: el principal desafío para los hospitales con presiones de costos es tratar a todos los pacientes que puedan de manera eficiente, teniendo en cuenta la mejora de la calidad de la atención. Los datos de instrumentos y máquinas se utilizan cada vez más para rastrear y optimizar el flujo del paciente, el tratamiento y el equipo utilizado en los hospitales. Se estima que habrá un aumento de la eficiencia del 1% que podría generar más de $ 63 mil millones en los ahorros de salud a nivel mundial.

Atención médica: el principal desafío para los hospitales con presiones de costos es tratar a todos los pacientes que puedan de manera eficiente, teniendo en cuenta la mejora de la calidad de la atención. Los datos de instrumentos y máquinas se utilizan cada vez más para rastrear y optimizar el flujo del paciente, el tratamiento y el equipo utilizado en los hospitales. Se estima que habrá un aumento de la eficiencia del 1% que podría generar más de $ 63 mil millones en los ahorros de salud a nivel mundial.

Viajes: el análisis de datos puede optimizar la experiencia de compra a través del móvil / weblog y el análisis de datos de redes sociales. Las vistas de viaje pueden obtener información sobre los deseos y preferencias del cliente. Los productos se pueden vender mediante la correlación de las ventas actuales con la navegación posterior, lo que incrementa las conversiones de navegación para comprar a través de paquetes y ofertas personalizados. Las recomendaciones de viaje personalizadas también se pueden entregar mediante análisis de datos basados en datos de redes sociales.

Viajes: el análisis de datos puede optimizar la experiencia de compra a través del móvil / weblog y el análisis de datos de redes sociales. Las vistas de viaje pueden obtener información sobre los deseos y preferencias del cliente. Los productos se pueden vender mediante la correlación de las ventas actuales con la navegación posterior, lo que incrementa las conversiones de navegación para comprar a través de paquetes y ofertas personalizados. Las recomendaciones de viaje personalizadas también se pueden entregar mediante análisis de datos basados en datos de redes sociales.

Juegos: Data Analytics ayuda a recopilar datos para optimizar y gastar tanto dentro como a través de juegos. Las compañías de juegos obtienen información sobre los disgustos, las relaciones y los gustos de los usuarios.

Juegos: Data Analytics ayuda a recopilar datos para optimizar y gastar tanto dentro como a través de juegos. Las compañías de juegos obtienen información sobre los disgustos, las relaciones y los gustos de los usuarios.

Gestión de la energía: la mayoría de las empresas utilizan el análisis de datos para la gestión de la energía, incluida la gestión de redes inteligentes, la optimización de la energía, la distribución de energía y la automatización de edificios en las empresas de servicios públicos. La aplicación aquí se centra en el control y monitoreo de dispositivos de red, equipos de despacho y administración de cortes de servicio. Las utilidades tienen la capacidad de integrar millones de puntos de datos en el rendimiento de la red y permiten a los ingenieros usar los análisis para monitorear la red.

Gestión de la energía: la mayoría de las empresas utilizan el análisis de datos para la gestión de la energía, incluida la gestión de redes inteligentes, la optimización de la energía, la distribución de energía y la automatización de edificios en las empresas de servicios públicos. La aplicación aquí se centra en el control y monitoreo de dispositivos de red, equipos de despacho y administración de cortes de servicio. Las utilidades tienen la capacidad de integrar millones de puntos de datos en el rendimiento de la red y permiten a los ingenieros usar los análisis para monitorear la red.

Fuente: SimpliLearn

Aplicaciones de Data Science:

Aplicaciones de Big Data:

- Analítica de clientes

- Analítica de cumplimiento

- Analítica de fraudes

- Analítica operativa

Aplicaciones de Data Analytics:

Fuente: SimpliLearn

- 02 Dic 2018, 20:19

- Foros: BI & Data Sciences

- Tema: Data Science vs. Big Data vs. Data Analytics [Parte 1]

- Respuestas: 0

- Vistas: 3128

Data Science vs. Big Data vs. Data Analytics [Parte 1]

Los datos están en todas partes. De hecho, la cantidad de datos digitales que existen crece a un ritmo acelerado, se duplica cada dos años y cambia la forma en que vivimos. Según IBM , en 2012 se generaron 2.500 millones de gigabytes (GB) de datos todos los días.

Un artículo de Forbes afirma que los datos crecen más rápido que nunca y para el año 2020, se crearán aproximadamente 1,7 megabytes de información nueva cada segundo para cada ser humano en el planeta.

Lo que hace que sea extremadamente importante al menos conocer los conceptos básicos del campo. Después de todo, aquí es donde está nuestro futuro.

En este post, diferenciaremos entre Data Science, Big Data y Data Analytics, en función de qué es, dónde se usa, las habilidades que necesita para convertirse en un profesional en el campo y las perspectivas salariales en cada campo.

Primero comencemos con entender cuáles son estos conceptos.

Lo que ellos son:

Data Science: que trata con datos no estructurados y estructurados, Data Science es un campo que comprende todo lo relacionado con la limpieza, preparación y análisis de datos.

La ciencia de datos es la combinación de estadísticas, matemáticas, programación, resolución de problemas, captura de datos de formas ingeniosas, la capacidad de ver las cosas de manera diferente y la actividad de limpieza, preparación y alineación de los datos.

En términos simples, es el paraguas de las técnicas utilizadas al intentar extraer información e información de los datos.

Big Data: Big Data se refiere a enormes volúmenes de datos que no pueden procesarse de manera efectiva con las aplicaciones tradicionales que existen. El procesamiento de Big Data comienza con los datos sin procesar que no se agregan y, por lo general, es imposible almacenarlos en la memoria de una sola computadora.

Una palabra de moda que se usa para describir inmensos volúmenes de datos, tanto desestructurados como estructurados, Big Data inunda una empresa diariamente. Big Data es algo que se puede usar para analizar información que puede llevar a mejores decisiones y movimientos de negocios estratégicos.

La definición de Big Data, dada por Gartner, es: "Big Data es un gran volumen de información, y los activos de información de alta velocidad y / o gran variedad que demandan formas de procesamiento de información innovadoras y rentables que permiten una mejor comprensión, toma de decisiones, y automatización de procesos ”.

Data Analytics: es la ciencia de examinar los datos en bruto con el fin de sacar conclusiones acerca de esa información.

Data Analytics implica la aplicación de un proceso algorítmico o mecánico para obtener información. Por ejemplo, ejecutar una serie de conjuntos de datos para buscar correlaciones significativas entre sí.

Se utiliza en una serie de industrias para permitir a las organizaciones y empresas tomar mejores decisiones, así como verificar y refutar las teorías o modelos existentes.

El enfoque de Data Analytics reside en la inferencia, que es el proceso de derivar conclusiones que se basan únicamente en lo que el investigador ya sabe.: Análisis de datos de la ciencia de examinar los datos en bruto con el fin de sacar conclusiones acerca de esa información.

Fuente: SimpliLearn

Un artículo de Forbes afirma que los datos crecen más rápido que nunca y para el año 2020, se crearán aproximadamente 1,7 megabytes de información nueva cada segundo para cada ser humano en el planeta.

Lo que hace que sea extremadamente importante al menos conocer los conceptos básicos del campo. Después de todo, aquí es donde está nuestro futuro.

En este post, diferenciaremos entre Data Science, Big Data y Data Analytics, en función de qué es, dónde se usa, las habilidades que necesita para convertirse en un profesional en el campo y las perspectivas salariales en cada campo.

Primero comencemos con entender cuáles son estos conceptos.

Lo que ellos son:

Data Science: que trata con datos no estructurados y estructurados, Data Science es un campo que comprende todo lo relacionado con la limpieza, preparación y análisis de datos.

La ciencia de datos es la combinación de estadísticas, matemáticas, programación, resolución de problemas, captura de datos de formas ingeniosas, la capacidad de ver las cosas de manera diferente y la actividad de limpieza, preparación y alineación de los datos.

En términos simples, es el paraguas de las técnicas utilizadas al intentar extraer información e información de los datos.

Big Data: Big Data se refiere a enormes volúmenes de datos que no pueden procesarse de manera efectiva con las aplicaciones tradicionales que existen. El procesamiento de Big Data comienza con los datos sin procesar que no se agregan y, por lo general, es imposible almacenarlos en la memoria de una sola computadora.

Una palabra de moda que se usa para describir inmensos volúmenes de datos, tanto desestructurados como estructurados, Big Data inunda una empresa diariamente. Big Data es algo que se puede usar para analizar información que puede llevar a mejores decisiones y movimientos de negocios estratégicos.

La definición de Big Data, dada por Gartner, es: "Big Data es un gran volumen de información, y los activos de información de alta velocidad y / o gran variedad que demandan formas de procesamiento de información innovadoras y rentables que permiten una mejor comprensión, toma de decisiones, y automatización de procesos ”.

Data Analytics: es la ciencia de examinar los datos en bruto con el fin de sacar conclusiones acerca de esa información.

Data Analytics implica la aplicación de un proceso algorítmico o mecánico para obtener información. Por ejemplo, ejecutar una serie de conjuntos de datos para buscar correlaciones significativas entre sí.

Se utiliza en una serie de industrias para permitir a las organizaciones y empresas tomar mejores decisiones, así como verificar y refutar las teorías o modelos existentes.

El enfoque de Data Analytics reside en la inferencia, que es el proceso de derivar conclusiones que se basan únicamente en lo que el investigador ya sabe.: Análisis de datos de la ciencia de examinar los datos en bruto con el fin de sacar conclusiones acerca de esa información.

Fuente: SimpliLearn

- 02 Dic 2018, 20:05

- Foros: Inteligencia Artificial

- Tema: Documental "The Joy of AI"

- Respuestas: 0

- Vistas: 3001

Documental "The Joy of AI"

Clip:

El profesor Jim Al-Khalili observa cómo hemos creado máquinas que pueden simular, aumentar e incluso superar a la mente humana, y por qué no debemos dejar que esto nos asuste. Revela la historia de la búsqueda de la IA, el surgimiento del aprendizaje automático y los recientes avances logrados por las redes neuronales artificiales. Él muestra cómo la IA no solo está cambiando nuestro mundo, sino también desafiando nuestras ideas de inteligencia y conciencia. En el camino, investigaremos los filtros de correo no deseado, conoceremos un chatbot de vanguardia, veremos por qué unos pocos píxeles alterados hacen que una computadora piense que está mirando un trombón en lugar de un perro y hablar con Demis Hassabis, quien dirige DeepMind y la misión es "resolver la inteligencia y luego usarla para resolver todo lo demás". Stephen Hawking comentó ' AI podría ser el evento más grande en la historia de nuestra civilización. O lo peor '. Jim sostiene que la IA es una herramienta nueva y potente que debería mejorar nuestras vidas, no reemplazarnos.

Documental Completo:

https://ihavenotv.com/the-joy-of-ai

El profesor Jim Al-Khalili observa cómo hemos creado máquinas que pueden simular, aumentar e incluso superar a la mente humana, y por qué no debemos dejar que esto nos asuste. Revela la historia de la búsqueda de la IA, el surgimiento del aprendizaje automático y los recientes avances logrados por las redes neuronales artificiales. Él muestra cómo la IA no solo está cambiando nuestro mundo, sino también desafiando nuestras ideas de inteligencia y conciencia. En el camino, investigaremos los filtros de correo no deseado, conoceremos un chatbot de vanguardia, veremos por qué unos pocos píxeles alterados hacen que una computadora piense que está mirando un trombón en lugar de un perro y hablar con Demis Hassabis, quien dirige DeepMind y la misión es "resolver la inteligencia y luego usarla para resolver todo lo demás". Stephen Hawking comentó ' AI podría ser el evento más grande en la historia de nuestra civilización. O lo peor '. Jim sostiene que la IA es una herramienta nueva y potente que debería mejorar nuestras vidas, no reemplazarnos.

Documental Completo:

https://ihavenotv.com/the-joy-of-ai

- 02 Dic 2018, 19:53

- Foros: Inteligencia Artificial

- Tema: La IA marca posibles delincuentes en Inglaterra.

- Respuestas: 0

- Vistas: 3072

La IA marca posibles delincuentes en Inglaterra.

La policía británica desea usar la inteligencia artificial para resaltar quién está en riesgo de convertirse en un criminal antes de que haya cometido algún delito.

Aunque suena como una pesadilla distópica, hay beneficios claros.

Se pueden asignar recursos y programas de divulgación para intentar prevenir un crimen, evitar que alguien se convierta en una víctima y eliminar los costos asociados con el procesamiento y encarcelamiento de alguien.

Con las prisiones sobrecargadas y el espacio limitado, reducir la necesidad de encerrar a alguien es una victoria para todos. Los tribunales también pueden priorizar otros asuntos para mejorar la eficiencia de toda la infraestructura legal.

El sistema propuesto se llama Solución Nacional de Análisis de Datos (NDAS) y utiliza datos de las bases de datos de la policía local y nacional.

Según el líder del proyecto de NDAS, se ha recopilado más de un terabyte de datos de las bases de datos mencionadas anteriormente. Estos datos incluyen registros de delitos cometidos, además de alrededor de cinco millones de personas identificables.

Hay más de 1,400 indicadores dentro de los datos que la IA utiliza para calcular el riesgo de un individuo de cometer un delito. Dichos indicadores podrían incluir delitos pasados, si la persona recibió asistencia y si aquellos en su red son delincuentes.

Para aliviar algunos temores, no hay planes para arrestar a alguien antes de que hayan cometido un delito en función de su potencial. El sistema está diseñado como una medida preventiva.

Fuente: AI news.

Aunque suena como una pesadilla distópica, hay beneficios claros.

Se pueden asignar recursos y programas de divulgación para intentar prevenir un crimen, evitar que alguien se convierta en una víctima y eliminar los costos asociados con el procesamiento y encarcelamiento de alguien.

Con las prisiones sobrecargadas y el espacio limitado, reducir la necesidad de encerrar a alguien es una victoria para todos. Los tribunales también pueden priorizar otros asuntos para mejorar la eficiencia de toda la infraestructura legal.

El sistema propuesto se llama Solución Nacional de Análisis de Datos (NDAS) y utiliza datos de las bases de datos de la policía local y nacional.

Según el líder del proyecto de NDAS, se ha recopilado más de un terabyte de datos de las bases de datos mencionadas anteriormente. Estos datos incluyen registros de delitos cometidos, además de alrededor de cinco millones de personas identificables.

Hay más de 1,400 indicadores dentro de los datos que la IA utiliza para calcular el riesgo de un individuo de cometer un delito. Dichos indicadores podrían incluir delitos pasados, si la persona recibió asistencia y si aquellos en su red son delincuentes.

Para aliviar algunos temores, no hay planes para arrestar a alguien antes de que hayan cometido un delito en función de su potencial. El sistema está diseñado como una medida preventiva.

Fuente: AI news.

- 02 Dic 2018, 19:50

- Foros: Inteligencia Artificial

- Tema: Cómo ayuda la IA a predecir el valor de las criptomonedas

- Respuestas: 0

- Vistas: 2746

Cómo ayuda la IA a predecir el valor de las criptomonedas

Las criptomonedas han recorrido un largo camino desde que se anunció por primera vez Bitcoin a fines de 2008. En solo una década, el mercado se disparó de cero a unos $ 400 mil millones, y desde entonces se han lanzado otras 3.000 criptomonedas . Pero este éxito no ha estado exento de altibajos. Bitcoin solo ha fluctuado de casi $ 20,000 a menos de un centavo durante este tiempo. Se puede ganar mucho dinero en la criptomoneda y perder mucho dinero. Afortunadamente para los inversores (y desarrolladores), la inteligencia artificial (AI) proporciona formas de navegar este mercado volátil .

EXTRAER VALOR DEL ANÁLISIS DEL SENTIMIENTO.

Determinar el valor de las criptomonedas es complicado. A diferencia del mercado de valores convencional, el valor no se corresponde estrechamente con factores como el flujo de efectivo o los activos disponibles. En cambio, los inversores deben confiar en el sentimiento. Pero, ¿cómo le dan sentido a todo lo que se dice de manera oportuna? El desarrollador Teju Tadi cree que puede tener la respuesta.

La mayoría de los movimientos de precios en la criptomoneda pueden ser determinados por el instinto de la manada, cuando las personas piensan y actúan de la misma manera que la mayoría de los que las rodean. En base a esto, Teju dice que el análisis de sentimiento de los titulares de noticias, publicaciones de Reddit y tweets es un buen indicador de la dirección de los movimientos de precios de la criptomoneda. Mediante el uso de redes tensoriales neuronales recursivas (RNTN), Teju ya está analizando el sentimiento de estos textos breves para desarrollar un robot de comercio de criptomoneda AI.

REDES TENSORIALES NEURONALES RECURSIVAS

Las RNTN evalúan la composición semántica del texto, que es vital para poder determinar con precisión el sentimiento a partir de un conjunto disperso de información como un tweet.

RNTNs analiza los datos en un árbol binario. Las representaciones de vectores específicos están formadas por todas las palabras y se representan como hojas. Desde abajo hacia arriba, estos vectores se convierten en los parámetros para optimizar y servir como entradas de características para un clasificador de softmax *. Los vectores se clasifican en cinco clases y se les asigna una puntuación.

“Cuando las similitudes se codifican entre dos palabras, los dos vectores se mueven a través de la siguiente raíz. Una puntuación y una clase se producen. Una puntuación representa la positividad o negatividad de un análisis, mientras que la clase codifica la estructura en los análisis actuales. El primer grupo de hojas recibe el análisis y luego la segunda recibe la siguiente palabra. La puntuación del análisis con las tres palabras se envía y pasa al siguiente grupo raíz ", dice Teju.

'El proceso de recursión continúa hasta que se agotan todas las entradas, con cada palabra incluida. En aplicaciones prácticas, las RNTN son más complejas que esto. En lugar de usar la siguiente palabra inmediata en una oración para el siguiente grupo de hojas, una RNTN probaría todas las siguientes palabras y, finalmente, verificará los vectores que representan subparposes completos. "Realizando esto en cada paso del proceso recursivo, la RNTN puede analizar cada puntuación posible del análisis sintáctico".

Teju también explica el proceso en este video: https://intel.ly/2DAprn9

TECNOLOGÍAS DE APOYO

Como miembro de la Intel® AI Academy, Teju pudo usar el Intel® AI DevCloud para ejecutar las redes neuronales recurrentes y experimentar con los datos de Twitter para ver cómo funcionaban los modelos. Al ejecutarse en procesadores escalables Intel® Xeon®, el Intel AI DevCloud está precargado con marcos y herramientas para lanzar rápidamente proyectos de aprendizaje automático y aprendizaje profundo. Estos incluyen el framework neon ™, la optimización Intel® para Theano *, la optimización Intel® para TensorFlow *, la optimización Intel® para Caffe *, la distribución Intel® para Python * (incluyendo NumPy, SciPy y scikit-learn *) y la biblioteca Keras * .

Si está considerando comenzar un proyecto de aprendizaje profundo, la sección Cómo comenzar con Intel AI DevCloud le dará una buena comprensión de los modelos disponibles y cómo iniciar el entrenamiento utilizando el AI DevCloud.

OPORTUNIDADES PARA DESARROLLADORES

Teju ha establecido un negocio Mycointrac *, centrado en proporcionar inteligencia de mercado de criptomonedas. "Una vez que el producto esté completamente desarrollado", dijo, "planeo utilizar los datos proporcionados por él como uno de los factores para tomar decisiones de inversión clave para mi nuevo fondo de cobertura de criptomoneda, Sentience Investments LP, que ha estado operativo desde el primero de enero. . El plan es desarrollar estrategias comerciales basadas en una serie de técnicas de aprendizaje automático de alta frecuencia, así como en un profundo aprendizaje y análisis de sentimientos ".

Teju espera que las RNTN también lo ayuden a aprovechar otras oportunidades, como el arbitraje, la compra y venta simultáneas de un activo en diferentes mercados. El beneficio es la diferencia entre los dos precios de mercado.

El sector financiero ofrece muchas oportunidades excelentes para los desarrolladores que pueden utilizar AI para abordar algunos de sus desafíos más apremiantes. Por ejemplo, obtener consistentemente altos rendimientos de las inversiones en el mercado de valores.

Fuente: AI news.

EXTRAER VALOR DEL ANÁLISIS DEL SENTIMIENTO.

Determinar el valor de las criptomonedas es complicado. A diferencia del mercado de valores convencional, el valor no se corresponde estrechamente con factores como el flujo de efectivo o los activos disponibles. En cambio, los inversores deben confiar en el sentimiento. Pero, ¿cómo le dan sentido a todo lo que se dice de manera oportuna? El desarrollador Teju Tadi cree que puede tener la respuesta.

La mayoría de los movimientos de precios en la criptomoneda pueden ser determinados por el instinto de la manada, cuando las personas piensan y actúan de la misma manera que la mayoría de los que las rodean. En base a esto, Teju dice que el análisis de sentimiento de los titulares de noticias, publicaciones de Reddit y tweets es un buen indicador de la dirección de los movimientos de precios de la criptomoneda. Mediante el uso de redes tensoriales neuronales recursivas (RNTN), Teju ya está analizando el sentimiento de estos textos breves para desarrollar un robot de comercio de criptomoneda AI.

REDES TENSORIALES NEURONALES RECURSIVAS

Las RNTN evalúan la composición semántica del texto, que es vital para poder determinar con precisión el sentimiento a partir de un conjunto disperso de información como un tweet.

RNTNs analiza los datos en un árbol binario. Las representaciones de vectores específicos están formadas por todas las palabras y se representan como hojas. Desde abajo hacia arriba, estos vectores se convierten en los parámetros para optimizar y servir como entradas de características para un clasificador de softmax *. Los vectores se clasifican en cinco clases y se les asigna una puntuación.

“Cuando las similitudes se codifican entre dos palabras, los dos vectores se mueven a través de la siguiente raíz. Una puntuación y una clase se producen. Una puntuación representa la positividad o negatividad de un análisis, mientras que la clase codifica la estructura en los análisis actuales. El primer grupo de hojas recibe el análisis y luego la segunda recibe la siguiente palabra. La puntuación del análisis con las tres palabras se envía y pasa al siguiente grupo raíz ", dice Teju.

'El proceso de recursión continúa hasta que se agotan todas las entradas, con cada palabra incluida. En aplicaciones prácticas, las RNTN son más complejas que esto. En lugar de usar la siguiente palabra inmediata en una oración para el siguiente grupo de hojas, una RNTN probaría todas las siguientes palabras y, finalmente, verificará los vectores que representan subparposes completos. "Realizando esto en cada paso del proceso recursivo, la RNTN puede analizar cada puntuación posible del análisis sintáctico".

Teju también explica el proceso en este video: https://intel.ly/2DAprn9

TECNOLOGÍAS DE APOYO

Como miembro de la Intel® AI Academy, Teju pudo usar el Intel® AI DevCloud para ejecutar las redes neuronales recurrentes y experimentar con los datos de Twitter para ver cómo funcionaban los modelos. Al ejecutarse en procesadores escalables Intel® Xeon®, el Intel AI DevCloud está precargado con marcos y herramientas para lanzar rápidamente proyectos de aprendizaje automático y aprendizaje profundo. Estos incluyen el framework neon ™, la optimización Intel® para Theano *, la optimización Intel® para TensorFlow *, la optimización Intel® para Caffe *, la distribución Intel® para Python * (incluyendo NumPy, SciPy y scikit-learn *) y la biblioteca Keras * .

Si está considerando comenzar un proyecto de aprendizaje profundo, la sección Cómo comenzar con Intel AI DevCloud le dará una buena comprensión de los modelos disponibles y cómo iniciar el entrenamiento utilizando el AI DevCloud.

OPORTUNIDADES PARA DESARROLLADORES

Teju ha establecido un negocio Mycointrac *, centrado en proporcionar inteligencia de mercado de criptomonedas. "Una vez que el producto esté completamente desarrollado", dijo, "planeo utilizar los datos proporcionados por él como uno de los factores para tomar decisiones de inversión clave para mi nuevo fondo de cobertura de criptomoneda, Sentience Investments LP, que ha estado operativo desde el primero de enero. . El plan es desarrollar estrategias comerciales basadas en una serie de técnicas de aprendizaje automático de alta frecuencia, así como en un profundo aprendizaje y análisis de sentimientos ".

Teju espera que las RNTN también lo ayuden a aprovechar otras oportunidades, como el arbitraje, la compra y venta simultáneas de un activo en diferentes mercados. El beneficio es la diferencia entre los dos precios de mercado.

El sector financiero ofrece muchas oportunidades excelentes para los desarrolladores que pueden utilizar AI para abordar algunos de sus desafíos más apremiantes. Por ejemplo, obtener consistentemente altos rendimientos de las inversiones en el mercado de valores.

Fuente: AI news.

- 02 Dic 2018, 13:06

- Foros: Inteligencia Artificial

- Tema: Nuevo método se asoma dentro de la 'caja negra' de la IA

- Respuestas: 0

- Vistas: 3085

Nuevo método se asoma dentro de la 'caja negra' de la IA

Los investigadores ayudan a explicar por qué los algoritmos de aprendizaje automático a veces generan respuestas sin sentido.

La inteligencia artificial, específicamente el aprendizaje automático, es parte de la vida diaria de los usuarios de computadoras y teléfonos inteligentes. Desde autocorrectar errores tipográficos hasta recomendar música nueva, los algoritmos de aprendizaje automático pueden ayudar a hacer la vida más fácil. También pueden cometer errores.

Puede ser un desafío para los científicos informáticos descubrir qué fue lo que salió mal en tales casos. Esto se debe a que muchos algoritmos de aprendizaje automático aprenden de la información y hacen sus predicciones dentro de una "caja negra" virtual, lo que deja algunas pistas que los investigadores pueden seguir.

Un grupo de científicos informáticos de la Universidad de Maryland ha desarrollado un enfoque nuevo y prometedor para interpretar los algoritmos de aprendizaje automático. A diferencia de los esfuerzos anteriores, que normalmente intentaban "romper" los algoritmos eliminando palabras clave de las entradas para obtener una respuesta incorrecta, el grupo UMD en cambio reducía las entradas al mínimo necesario para obtener la respuesta correcta. En promedio, los investigadores obtuvieron la respuesta correcta con una entrada de menos de tres palabras.

En algunos casos, los algoritmos modelo de los investigadores proporcionaron la respuesta correcta basada en una sola palabra. Con frecuencia, la palabra o frase de entrada parecía tener poca conexión obvia con la respuesta, revelando información importante sobre cómo reaccionan algunos algoritmos a un lenguaje específico. Debido a que muchos algoritmos están programados para dar una respuesta sin importar lo que ocurra, incluso cuando lo solicite una información sin sentido, los resultados podrían ayudar a los científicos informáticos a construir algoritmos más efectivos que puedan reconocer sus propias limitaciones.

Los investigadores presentarán su trabajo el 4 de noviembre de 2018 en la Conferencia de 2018 sobre Métodos Empíricos en el Procesamiento del Lenguaje Natural.

"Los modelos de caja negra parecen funcionar mejor que los modelos más simples, como los árboles de decisión, pero incluso las personas que escribieron el código inicial no pueden decir exactamente lo que está sucediendo", dijo Jordan Boyd-Graber, autor principal del estudio. y profesor asociado de informática en la UMD. "Cuando estos modelos devuelven respuestas incorrectas o sin sentido, es difícil averiguar por qué. Entonces, en lugar de eso, intentamos encontrar la información mínima que daría el resultado correcto. La entrada promedio fue de aproximadamente tres palabras, pero podríamos reducirla a una una sola palabra en algunos casos ".

En un ejemplo, los investigadores introdujeron una foto de un girasol y la pregunta basada en el texto "¿De qué color es la flor?" como entradas en un algoritmo modelo. Estas entradas dieron la respuesta correcta de "amarillo". Después de reformular la pregunta en varias combinaciones diferentes de palabras, los investigadores encontraron que podían obtener la misma respuesta con "¿flor?" como la única entrada de texto para el algoritmo.

En otro ejemplo, más complejo, los investigadores utilizaron el indicador: "En 1899, John Jacob Astor IV invirtió $ 100,000 para que Tesla desarrollara y produjera un nuevo sistema de iluminación. En cambio, Tesla usó el dinero para financiar sus experimentos en Colorado Springs".

Luego le preguntaron al algoritmo: "¿En qué gastó Tesla el dinero de Astor?" y recibió la respuesta correcta, "experimentos de Colorado Springs". Al reducir esta entrada a la única palabra "did" se obtuvo la misma respuesta correcta.

El trabajo revela información importante sobre las reglas que los algoritmos de aprendizaje automático aplican a la resolución de problemas. Muchos problemas del mundo real con algoritmos se producen cuando una entrada que tiene sentido para los humanos da como resultado una respuesta sin sentido. Al mostrar que también es posible lo contrario, que los insumos sin sentido también pueden dar respuestas correctas y sensatas, Boyd-Graber y sus colegas demuestran la necesidad de algoritmos que puedan reconocer cuando responden a una pregunta sin sentido con un alto grado de confianza.

"La conclusión es que todo este material de aprendizaje automático puede ser bastante estúpido", dijo Boyd-Graber, quien también tiene citas en el Instituto de Estudios Avanzados en Informática de la Universidad de Maryland (UMIACS) y en la Escuela de Información de la UMD. Centro de Estudios y Ciencias del Lenguaje. "Cuando los científicos informáticos entrenan estos modelos, normalmente solo les mostramos preguntas reales u oraciones reales. No les mostramos frases sin sentido ni palabras simples. Los modelos no saben que estos ejemplos deben confundirlos".

La mayoría de los algoritmos se obligarán a proporcionar una respuesta, incluso con datos insuficientes o en conflicto, según Boyd-Graber. Esto podría estar en el centro de algunos de los resultados incorrectos o sin sentido generados por los algoritmos de aprendizaje automático, en los algoritmos modelo utilizados para la investigación, así como en los algoritmos del mundo real que nos ayudan a marcar correos electrónicos no deseados u ofrecer direcciones de conducción alternativas. Comprender más sobre estos errores podría ayudar a los científicos informáticos a encontrar soluciones y construir algoritmos más confiables.

"Demostramos que las modelos pueden ser entrenadas para saber que deben estar confundidas", dijo Boyd-Graber. "Entonces pueden simplemente salir y decir: 'Me has mostrado algo que no puedo entender'".

Además de Boyd-Graber, los investigadores afiliados a UMD que participan en este trabajo incluyen al investigador universitario Eric Wallace; estudiantes de posgrado Shi Feng y Pedro Rodríguez; y el ex estudiante de posgrado Mohit Iyyer (MS '14, Ph.D. '17, ciencias de la computación).

La presentación de la investigación, "Las patologías de los modelos neurales hacen que la interpretación sea difícil", Shi Feng, Eric Wallace, Alvin Grissom II, Pedro Rodríguez, Mohit Iyyer y Jordan Boyd-Graber se presentarán en la Conferencia de 2018 sobre Métodos empíricos en el procesamiento del lenguaje natural el 4 de noviembre de 2018.

Este trabajo fue apoyado por la Agencia de Proyectos de Investigación Avanzada de la Defensa (Premio No. HR0011-15-C-011) y la Fundación Nacional de Ciencias (Premio No. IIS1652666). El contenido de este post no refleja necesariamente las opiniones de estas organizaciones.

Fuente: ScienceDaily.

La inteligencia artificial, específicamente el aprendizaje automático, es parte de la vida diaria de los usuarios de computadoras y teléfonos inteligentes. Desde autocorrectar errores tipográficos hasta recomendar música nueva, los algoritmos de aprendizaje automático pueden ayudar a hacer la vida más fácil. También pueden cometer errores.

Puede ser un desafío para los científicos informáticos descubrir qué fue lo que salió mal en tales casos. Esto se debe a que muchos algoritmos de aprendizaje automático aprenden de la información y hacen sus predicciones dentro de una "caja negra" virtual, lo que deja algunas pistas que los investigadores pueden seguir.

Un grupo de científicos informáticos de la Universidad de Maryland ha desarrollado un enfoque nuevo y prometedor para interpretar los algoritmos de aprendizaje automático. A diferencia de los esfuerzos anteriores, que normalmente intentaban "romper" los algoritmos eliminando palabras clave de las entradas para obtener una respuesta incorrecta, el grupo UMD en cambio reducía las entradas al mínimo necesario para obtener la respuesta correcta. En promedio, los investigadores obtuvieron la respuesta correcta con una entrada de menos de tres palabras.

En algunos casos, los algoritmos modelo de los investigadores proporcionaron la respuesta correcta basada en una sola palabra. Con frecuencia, la palabra o frase de entrada parecía tener poca conexión obvia con la respuesta, revelando información importante sobre cómo reaccionan algunos algoritmos a un lenguaje específico. Debido a que muchos algoritmos están programados para dar una respuesta sin importar lo que ocurra, incluso cuando lo solicite una información sin sentido, los resultados podrían ayudar a los científicos informáticos a construir algoritmos más efectivos que puedan reconocer sus propias limitaciones.

Los investigadores presentarán su trabajo el 4 de noviembre de 2018 en la Conferencia de 2018 sobre Métodos Empíricos en el Procesamiento del Lenguaje Natural.

"Los modelos de caja negra parecen funcionar mejor que los modelos más simples, como los árboles de decisión, pero incluso las personas que escribieron el código inicial no pueden decir exactamente lo que está sucediendo", dijo Jordan Boyd-Graber, autor principal del estudio. y profesor asociado de informática en la UMD. "Cuando estos modelos devuelven respuestas incorrectas o sin sentido, es difícil averiguar por qué. Entonces, en lugar de eso, intentamos encontrar la información mínima que daría el resultado correcto. La entrada promedio fue de aproximadamente tres palabras, pero podríamos reducirla a una una sola palabra en algunos casos ".

En un ejemplo, los investigadores introdujeron una foto de un girasol y la pregunta basada en el texto "¿De qué color es la flor?" como entradas en un algoritmo modelo. Estas entradas dieron la respuesta correcta de "amarillo". Después de reformular la pregunta en varias combinaciones diferentes de palabras, los investigadores encontraron que podían obtener la misma respuesta con "¿flor?" como la única entrada de texto para el algoritmo.

En otro ejemplo, más complejo, los investigadores utilizaron el indicador: "En 1899, John Jacob Astor IV invirtió $ 100,000 para que Tesla desarrollara y produjera un nuevo sistema de iluminación. En cambio, Tesla usó el dinero para financiar sus experimentos en Colorado Springs".

Luego le preguntaron al algoritmo: "¿En qué gastó Tesla el dinero de Astor?" y recibió la respuesta correcta, "experimentos de Colorado Springs". Al reducir esta entrada a la única palabra "did" se obtuvo la misma respuesta correcta.

El trabajo revela información importante sobre las reglas que los algoritmos de aprendizaje automático aplican a la resolución de problemas. Muchos problemas del mundo real con algoritmos se producen cuando una entrada que tiene sentido para los humanos da como resultado una respuesta sin sentido. Al mostrar que también es posible lo contrario, que los insumos sin sentido también pueden dar respuestas correctas y sensatas, Boyd-Graber y sus colegas demuestran la necesidad de algoritmos que puedan reconocer cuando responden a una pregunta sin sentido con un alto grado de confianza.

"La conclusión es que todo este material de aprendizaje automático puede ser bastante estúpido", dijo Boyd-Graber, quien también tiene citas en el Instituto de Estudios Avanzados en Informática de la Universidad de Maryland (UMIACS) y en la Escuela de Información de la UMD. Centro de Estudios y Ciencias del Lenguaje. "Cuando los científicos informáticos entrenan estos modelos, normalmente solo les mostramos preguntas reales u oraciones reales. No les mostramos frases sin sentido ni palabras simples. Los modelos no saben que estos ejemplos deben confundirlos".

La mayoría de los algoritmos se obligarán a proporcionar una respuesta, incluso con datos insuficientes o en conflicto, según Boyd-Graber. Esto podría estar en el centro de algunos de los resultados incorrectos o sin sentido generados por los algoritmos de aprendizaje automático, en los algoritmos modelo utilizados para la investigación, así como en los algoritmos del mundo real que nos ayudan a marcar correos electrónicos no deseados u ofrecer direcciones de conducción alternativas. Comprender más sobre estos errores podría ayudar a los científicos informáticos a encontrar soluciones y construir algoritmos más confiables.

"Demostramos que las modelos pueden ser entrenadas para saber que deben estar confundidas", dijo Boyd-Graber. "Entonces pueden simplemente salir y decir: 'Me has mostrado algo que no puedo entender'".

Además de Boyd-Graber, los investigadores afiliados a UMD que participan en este trabajo incluyen al investigador universitario Eric Wallace; estudiantes de posgrado Shi Feng y Pedro Rodríguez; y el ex estudiante de posgrado Mohit Iyyer (MS '14, Ph.D. '17, ciencias de la computación).

La presentación de la investigación, "Las patologías de los modelos neurales hacen que la interpretación sea difícil", Shi Feng, Eric Wallace, Alvin Grissom II, Pedro Rodríguez, Mohit Iyyer y Jordan Boyd-Graber se presentarán en la Conferencia de 2018 sobre Métodos empíricos en el procesamiento del lenguaje natural el 4 de noviembre de 2018.

Este trabajo fue apoyado por la Agencia de Proyectos de Investigación Avanzada de la Defensa (Premio No. HR0011-15-C-011) y la Fundación Nacional de Ciencias (Premio No. IIS1652666). El contenido de este post no refleja necesariamente las opiniones de estas organizaciones.

Fuente: ScienceDaily.

- 02 Dic 2018, 12:52

- Foros: Inteligencia Artificial

- Tema: Reproducción de cuadros con deep learning.

- Respuestas: 0

- Vistas: 2981

Reproducción de cuadros con deep learning.

Los marcos vacíos que cuelgan dentro del Museo Isabella Stewart Gardner sirven como un recordatorio tangible del mayor robo de arte sin resolver del mundo. Si bien las obras maestras originales nunca se pueden recuperar, un equipo del Laboratorio de Ciencias de la Computación e Inteligencia Artificial (CSAIL) del MIT podría ayudarlo, con un nuevo sistema destinado a diseñar reproducciones de pinturas.

RePaint utiliza una combinación de impresión en 3-D y aprendizaje profundo para recrear auténticamente sus pinturas favoritas, independientemente de las diferentes condiciones de iluminación o ubicación. RePaint podría usarse para rehacer obras de arte para un hogar, proteger originales contra el desgaste en museos, o incluso ayudar a las empresas a crear impresiones y postales de piezas históricas.

Para probar RePaint, el equipo reprodujo varias pinturas al óleo creadas por un artista colaborador. El equipo descubrió que RePaint era más de cuatro veces más preciso que los modelos físicos de última generación al crear los tonos de color exactos para diferentes obras de arte.

En este momento, las reproducciones son solo del tamaño de una tarjeta de visita, debido a la naturaleza costosa de la impresión. En el futuro, el equipo espera que las impresoras 3D más avanzadas y comerciales puedan ayudar a hacer pinturas más grandes de manera más eficiente.

Si bien las impresoras 2D son las más utilizadas para reproducir pinturas, tienen un conjunto fijo de solo cuatro tintas (cian, magenta, amarillo y negro). Los investigadores, sin embargo, encontraron una mejor manera de capturar un espectro más completo de Degas y Dali. Utilizaron una técnica especial que denominaron "tonificación del color", que consiste en usar una impresora 3D y 10 tintas transparentes diferentes apiladas en capas muy finas, como las obleas y el chocolate en una barra de Kit-Kat. Combinaron su método con una técnica de décadas de antigüedad llamada medio tono, en la que una imagen se crea con muchos puntos de colores pequeños en lugar de tonos continuos. Combinando estos, dice el equipo, capturó mejor los matices de los colores.

Con un alcance de color más amplio para trabajar, la pregunta de qué tintas usar para qué pinturas aún permanecen. En lugar de utilizar enfoques físicos más laboriosos, el equipo entrenó un modelo de aprendizaje profundo para predecir la pila óptima de tintas diferentes. Una vez que el sistema se hizo cargo de eso, se alimentaron con imágenes de pinturas y usaron el modelo para determinar qué colores deberían usarse en qué áreas en particular para pinturas específicas.

A pesar del progreso hasta ahora, el equipo dice que tienen algunas mejoras que hacer antes de que puedan crear un deslumbrante duplicado de "Starry Night". Por ejemplo, el ingeniero mecánico Mike Foshey dijo que no podían reproducir completamente ciertos colores como el azul cobalto. a una biblioteca de tinta limitada. En el futuro planean expandir esta biblioteca, así como crear un algoritmo específico de pintura para seleccionar tintas, dice. También pueden esperar obtener mejores detalles para tener en cuenta aspectos como la textura de la superficie y la reflexión, de modo que puedan lograr efectos específicos como acabados brillantes y mate.

"El valor de las bellas artes ha aumentado rápidamente en los últimos años, por lo que hay una mayor tendencia a que sea encerrado en almacenes lejos del ojo público", dice Foshey. "Estamos construyendo la tecnología para revertir esta tendencia y para crear reproducciones baratas y precisas que todos puedan disfrutar".

Kim y Foshey trabajaron en el sistema junto con el autor principal Liang Shi; Profesor de MIT Wojciech Matusik; el ex postdoctorado del MIT Vahid Babaei, ahora líder de grupo en el Instituto de Informática Max Planck; Szymon Rusinkiewicz, profesor de ciencias informáticas de la Universidad de Princeton; y el ex postdoctorado del MIT Pitchaya Sitthi-Amorn, que ahora es profesor en la Universidad de Chulalongkorn en Bangkok, Tailandia.

Este trabajo es apoyado en parte por la Fundación Nacional de Ciencia.

Fuente: MIT News.

RePaint utiliza una combinación de impresión en 3-D y aprendizaje profundo para recrear auténticamente sus pinturas favoritas, independientemente de las diferentes condiciones de iluminación o ubicación. RePaint podría usarse para rehacer obras de arte para un hogar, proteger originales contra el desgaste en museos, o incluso ayudar a las empresas a crear impresiones y postales de piezas históricas.

Para probar RePaint, el equipo reprodujo varias pinturas al óleo creadas por un artista colaborador. El equipo descubrió que RePaint era más de cuatro veces más preciso que los modelos físicos de última generación al crear los tonos de color exactos para diferentes obras de arte.

En este momento, las reproducciones son solo del tamaño de una tarjeta de visita, debido a la naturaleza costosa de la impresión. En el futuro, el equipo espera que las impresoras 3D más avanzadas y comerciales puedan ayudar a hacer pinturas más grandes de manera más eficiente.

Si bien las impresoras 2D son las más utilizadas para reproducir pinturas, tienen un conjunto fijo de solo cuatro tintas (cian, magenta, amarillo y negro). Los investigadores, sin embargo, encontraron una mejor manera de capturar un espectro más completo de Degas y Dali. Utilizaron una técnica especial que denominaron "tonificación del color", que consiste en usar una impresora 3D y 10 tintas transparentes diferentes apiladas en capas muy finas, como las obleas y el chocolate en una barra de Kit-Kat. Combinaron su método con una técnica de décadas de antigüedad llamada medio tono, en la que una imagen se crea con muchos puntos de colores pequeños en lugar de tonos continuos. Combinando estos, dice el equipo, capturó mejor los matices de los colores.

Con un alcance de color más amplio para trabajar, la pregunta de qué tintas usar para qué pinturas aún permanecen. En lugar de utilizar enfoques físicos más laboriosos, el equipo entrenó un modelo de aprendizaje profundo para predecir la pila óptima de tintas diferentes. Una vez que el sistema se hizo cargo de eso, se alimentaron con imágenes de pinturas y usaron el modelo para determinar qué colores deberían usarse en qué áreas en particular para pinturas específicas.

A pesar del progreso hasta ahora, el equipo dice que tienen algunas mejoras que hacer antes de que puedan crear un deslumbrante duplicado de "Starry Night". Por ejemplo, el ingeniero mecánico Mike Foshey dijo que no podían reproducir completamente ciertos colores como el azul cobalto. a una biblioteca de tinta limitada. En el futuro planean expandir esta biblioteca, así como crear un algoritmo específico de pintura para seleccionar tintas, dice. También pueden esperar obtener mejores detalles para tener en cuenta aspectos como la textura de la superficie y la reflexión, de modo que puedan lograr efectos específicos como acabados brillantes y mate.

"El valor de las bellas artes ha aumentado rápidamente en los últimos años, por lo que hay una mayor tendencia a que sea encerrado en almacenes lejos del ojo público", dice Foshey. "Estamos construyendo la tecnología para revertir esta tendencia y para crear reproducciones baratas y precisas que todos puedan disfrutar".

Kim y Foshey trabajaron en el sistema junto con el autor principal Liang Shi; Profesor de MIT Wojciech Matusik; el ex postdoctorado del MIT Vahid Babaei, ahora líder de grupo en el Instituto de Informática Max Planck; Szymon Rusinkiewicz, profesor de ciencias informáticas de la Universidad de Princeton; y el ex postdoctorado del MIT Pitchaya Sitthi-Amorn, que ahora es profesor en la Universidad de Chulalongkorn en Bangkok, Tailandia.

Este trabajo es apoyado en parte por la Fundación Nacional de Ciencia.

Fuente: MIT News.